| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

- 자료구조

- CS

- WEB

- 운영체제

- 개발

- 개념정리

- 취준

- 데이터베이스

- Service

- 에어플로우

- 데이터엔지니어링

- 기술면접

- 클라우드

- 데이터엔지니어

- 관계형데이터베이스

- Amazon

- Django

- 웹스크래핑

- 알고리즘

- 웹크롤링

- 파이썬

- airflow

- DataWarehouse

- 데이터웨어하우스

- 프로그래머스

- AWS

- 데브코스

- 부트캠프

- SQL

- 웹자동화

- Today

- Total

사진과 음악을 좋아하는 개발자 지망생의 블로그

[Web Scraping 기초] BeautifulSoup 본문

1) BeautifulSoup 라이브러리

- 스크래핑 하고자 하는 사이트에 get 요청을 보내서 받은 문서에서 .body를 할 경우 길고 정리되지 않은 텍스트로

인해 분석하기 힘들어 진다

- HTML, XML 등 긴 텍스트를 분석할 수 있도록 Parser를 사용할 수 있게 해주는 Python 패키지가 BeautifulSoup이다

- pip install을 통해 간단하게 실행할 수 있다 (cmd창에 아래 코드 입력, Jupyter Notebook에선 맨 앞에 % 붙임)

pip install bs4

2) BeatifulSoup 객체 만들기

- https://www.example.com 사이트에 get 요청을 보내 응답을 받아 requests 객체를 생성하고 이 객체를 활용하여

get요청으로 받은 문서를 BeautifulSoup 패키지를 활용해 parser하는 과정이다

- 추가로, perser된 문서를 그대로 print해도 상관없지만, prettify 메소드를 이용하면 더욱 보기 편하게 볼 수 있다.

# www.example.com 사이트를 요청한 후 응답 받아보기

import requests

res = requests.get("https://www.example.com")

# BeautifulSoup4 - bs4를 불러와봅시다.

from bs4 import BeautifulSoup

# BeautifulSoup객체를 만들어봅시다.

# 첫번째 인자로는 response의 body를 텍스트로 전달합니다.

# 두번째 인자로는 "html"로 분석한다는 것을 명시해줍니다.

soup = BeautifulSoup(res.text, "html.parser")

# 객체 soup의 .prettify()를 활용하면 분석된 HTML을 보기 편하게 반환해줍니다.

print(soup.prettify())

# print(soup)

3) 특정 요소 가져오기

- Beautiful 패키지는 parser 뿐만 아니라 html의 특정 요소를 가지고 올 수 있다

① <title> 가져오기

② <head> 가져오기

③ <body> 가져오기

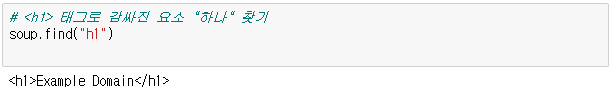

④ find("tag")

- 찾고자 하는 Tag를 문서에서 찾아 첫번째로 나온 Tag와 그것으로 감싸져 있는 Contents를 함께 반환해준다

⑤ find_all("tag")

- 찾고자 하는 Tag를 문서에서 찾고, 찾아진 모든 Tag와 그것으로 감싸져 있는 Contents를 함께 반환해준다

⑥.name Tag 이름 가져오기

⑦.text Tag내용 가져오기

'개발 > 웹 스크래핑' 카테고리의 다른 글

| [Web Scraping 기초] Selenium으로 웹브라우저 자동화하기 (0) | 2023.04.20 |

|---|---|

| [Web Scraping 기초] BeautifulSoup을 이용한 웹 스크래핑 (0) | 2023.04.19 |

| [Web Scraping 기초] HTTP - 윤리적으로 웹 스크래핑/크롤링 진행하기 (0) | 2023.04.18 |

| [Web Scraping 기초] HTTP - Python을 활용하여 간단한 HTTP 요청 주고받기 (0) | 2023.04.18 |

| [Web Scraping 기초] HTTP - Requests (1) | 2023.04.18 |